Recientemente, se ha hablado sobre el uso de inteligencia artificial (IA) en operaciones militares. La empresa Anthropic, que trabaja con herramientas de IA, ha sido mencionada en este contexto. Los mandos militares, incluyendo el Mando Central de EE.UU., han utilizado la IA de Anthropic para ayudar en la identificación de objetivos y en el análisis de información.

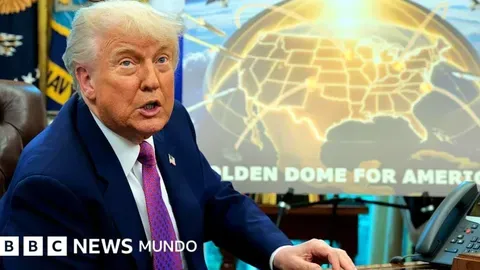

Según informes, el gobierno de EE.UU. pudo haber usado estas herramientas durante ataques en Irán. Esto se confirmó poco después de que el presidente Donald Trump anunciara que detendría el uso de estas tecnologías en el Pentágono.

Anthony Amodei, el director general de Anthropic, ha declarado que su empresa no permitirá que su tecnología se use para vigilancia masiva o para crear armas autónomas. Sin embargo, el Pentágono cree que necesita la IA para fines legales.

La herramienta Claude, creada por Anthropic, también se usó para atrapar al presidente venezolano Nicolás Maduro. Esto ha despertado preguntas sobre su uso en situaciones críticas, como el ataque que llevó a la muerte del líder iraní, Alí Jamenei.

Muchos empleados de empresas tecnológicas como Google y OpenAI apoyaron a Anthropic en su disputa con el Pentágono. Más de 400 personas firmaron una carta a favor de Anthropic. Por otro lado, OpenAI llegó a un acuerdo con el Ministerio de Defensa de EE.UU. para el uso seguro de sus modelos de IA.

La IA también se usa en el Proyecto Maven, un programa militar que analiza datos de imágenes de satélites y drones. Esto ayuda a encontrar búnkeres ocultos y objetivos militares con más eficiencia.

En resumen, el uso de la IA en conflictos como el de Irán y Venezuela está creciendo y plantea importantes preguntas sobre la ética y la seguridad en tiempos de guerra.

Discussion questions

- ¿Cuáles son las implicaciones éticas del uso de inteligencia artificial en operaciones militares, y cómo pueden influir en las decisiones de combate?

- ¿Deberían las empresas tecnológicas tener un papel activo en la regulación y limitación del uso de sus tecnologías en contextos militares? ¿Por qué sí o por qué no?

- ¿Cómo puede el uso de IA en la identificación de objetivos afectar la percepción pública sobre la guerra y las operaciones militares?

- ¿Qué contradicciones surgen entre la necesidad del Pentágono de utilizar IA para fines legales y las promesas de empresas como Anthropic de no permitir su uso en vigilancia masiva o armas autónomas?

- En su opinión, ¿cuál es el futuro de la inteligencia artificial en la guerra, y qué abismos éticos cree que podrían abrirse si no se gestionan adecuadamente?